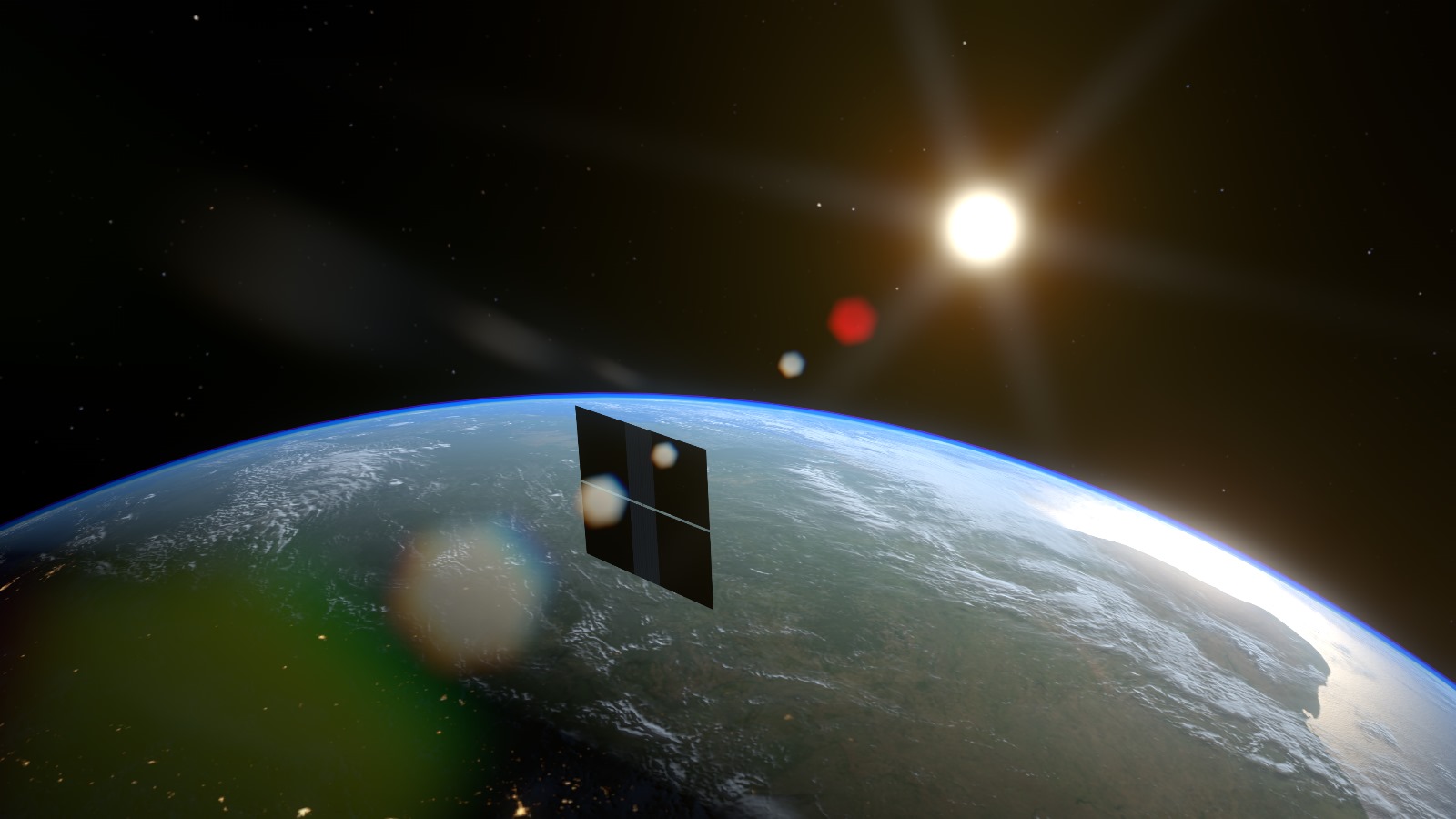

A Nvidia anunciou hardware pensado para rodar data centers de inteligência artificial em satélites em órbita terrestre.

A proposta abre possibilidades tecnológicas interessantes e também traz uma lista de desafios práticos que todo programador e empreendedor precisa entender.

Na prática, a ideia é aproveitar a disponibilidade de energia solar no espaço para alimentar aceleradores de IA longe da superfície.

Além disso, sistemas em órbita podem reduzir a dependência de refrigeração intensiva usada por racks terrestres, já que a gestão térmica no vácuo segue princípios diferentes.

Isso não significa que o resfriamento deixa de ser um problema, mas sim que as estratégias e custos são diferentes do datacenter tradicional.

Para aplicações, o conceito pode fazer sentido em cenários que exigem cobertura global sem infraestrutura local, como comunicação em áreas remotas, monitoramento ambiental em tempo real e serviços de baixa latência em regiões pouco conectadas.

No entanto, a latência e a largura de banda continuam limitantes importantes dependendo da altitude orbital e da arquitetura de enlace entre satélite e usuário.

Sistemas em órbita de baixa altitude (LEO) conseguem latências melhores do que satélites geoestacionários, mas ainda não substituem conexões locais para todas as aplicações.

Outro ponto crítico é a confiabilidade do hardware frente à radiação espacial e às vibrações de lançamento, o que exige componentes robustos ou camadas de correção de erros no software.

Isso impacta diretamente o design de modelos e de pipelines de inferência, que terão de tolerar falhas esporádicas e recuperar estados de forma eficiente.

Do ponto de vista econômico, custos de lançamento e manutenção são altos, então o caso de uso precisa justificar o investimento com ganho em alcance, disponibilidade ou performance global.

Para startups, a oportunidade aparece em nichos: empresas que oferecem serviços globais, redes de distribuição de modelos, processamento local em regiões remotas e soluções de observação da Terra com processamento embarcado.

Também haverá demanda por software que minimize tráfego, como quantização de modelos, inferência compressa, cache inteligente e sincronização eficiente entre órbita e solo.

Arquiteturas de edge distribuído e técnicas como compressão, sparsity e pruning podem se tornar ainda mais valiosas nesse contexto.

Além disso, modelos de negócios e compliance ganham complexidade com questões de soberania de dados, regulamentação espacial e acordos internacionais sobre tráfego e espectro.

A segurança tem papel central: comunicação entre satélites e pontos terrestres precisa ser criptografada e resistente a interferência, além de exigir controles para atualizações remotas seguras.

Para desenvolvedores, isso significa projetar sistemas que sejam resilientes, atualizáveis via enlaces limitados e capazes de operação com latência e perda de pacote variáveis.

Na prática, espere ver bibliotecas e frameworks adaptados para sincronização eficiente, métricas de tolerância a falhas e ferramentas de telemetria pensadas para enlaces espaciais.

Também é provável que surjam camadas de abstração que escondam a complexidade orbital, oferecendo APIs para deploy e orquestração de modelos em constelações de satélites.

Em resumo, a iniciativa da Nvidia coloca no radar uma nova fronteira para data centers de IA, com vantagens claras de alcance e energia e desafios relevantes de custo, confiabilidade e rede.

Se você trabalha com modelos, sistemas distribuídos ou cria produtos que precisam de cobertura global, vale acompanhar de perto as evoluções e começar a pensar em padrões de arquitetura que suportem operações intermitentes e enlaces limitados.

Quem quiser sair na frente pode explorar otimização de modelos para baixa largura de banda, estratégias de sincronização e testes de robustez a falhas, competências que serão valorizadas se a infraestrutra espacial realmente ganhar tração.