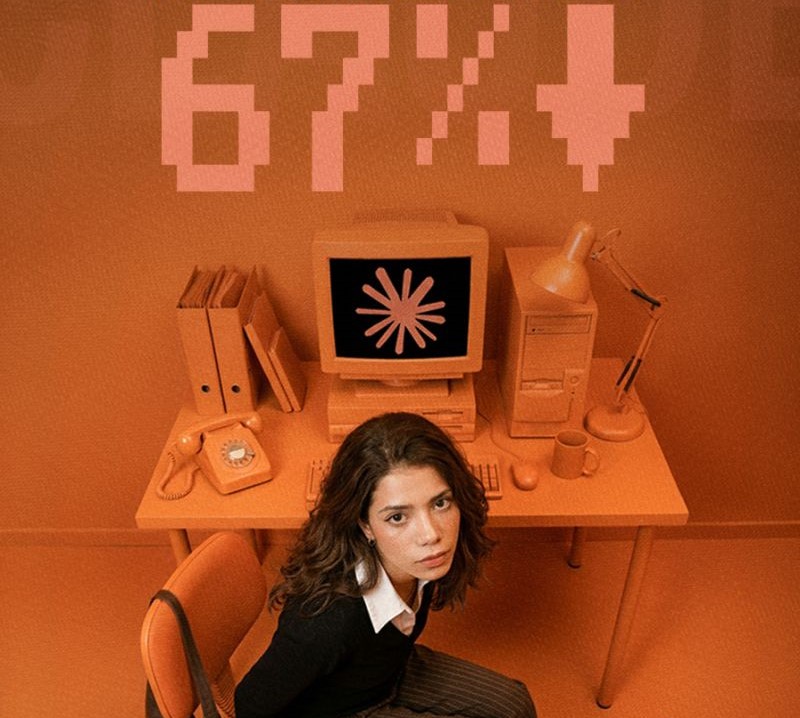

Anthropic lançou o Claude Opus 4.7 com promessas de maior precisão e rigor em tarefas complexas, mas usuários reportam respostas contraditórias, autocorreções e perda de fluidez em comparação ao 4.6.

Anthropic lançou o Claude Opus 4.7 prometendo desempenho superior em tarefas longas e raciocínio consistente.

Logo após o lançamento, usuários relataram respostas contraditórias, autocorreções repetidas no próprio texto e queda de coerência em comparação ao 4.6.

Em comunidades como o Reddit, exemplos descrevem o modelo começando uma prova ou raciocínio e depois interrompendo-se várias vezes com variações de “espera, isso não funciona” durante a mesma resposta.

Alguns desenvolvedores passaram a chamar esse fenômeno de “AI shrinkflation”: mesma versão com menos forma e função, seja por controles de segurança mais rígidos, limitações operacionais ou throttling.

Guy Currier, analista do The Futurum Group, afirma que esse comportamento não deve ser tratado como um bug, mas como parte de uma fase de maturação da tecnologia após o período de euforia inicial.

“The first stage was euphoria: throw everything at generative AI, marvel at the output, promote your use of it,” Currier diz.

“Now, in the second stage, we’re experiencing failures and discouragement,” ele acrescenta, e argumenta que Anthropic tenta reduzir o tom autoritário do modelo fazendo-o questionar sua própria confiança.

Outro ponto citado por usuários e observadores é a redução do “esforço” disponível por consulta — ou seja, a quantidade de tokens de raciocínio que o modelo pode gastar — algo que teria sido limitado antes do lançamento do 4.7.

Jan Hauser, cofundador da Applifting, também ressalta que expectativas muito altas tornam qualquer queda de qualidade mais visível e que fatores como “context rot” e a decisão de usar o contexto de 1 milhão de tokens como padrão podem piorar a percepção de degradação.

Enquanto isso, a OpenAI lançou atualizações no Codex voltadas a desenvolvedores; no blog a organização escreveu: “The Codex app also now includes deeper support for developer workflows, like reviewing PRs, viewing multiple files & terminals, connecting to remote devboxes via SSH, and an in-app browser to make it faster to iterate on frontend designs, apps, and games.”

Para desenvolvedores, isso levanta questões sobre trade-offs intencionais entre segurança, custo de inferência e desempenho, além do efeito acumulado de conteúdo e contexto que pode degradar respostas ao longo do tempo.

No fim, a discussão mostra que manter consistência e alto desempenho em modelos complexos é um desafio técnico e organizacional, com decisões que podem agradar a reguladores de segurança e desencantar parte da base de usuários avançados.